人工智能安全遇上战争机器

作者: aeks | 发布时间: 2026-02-23 08:05 | 更新时间: 2026-02-23 08:05

学科分类: 兵器科学与技术 军事装备学 国家安全学 计算机科学与技术

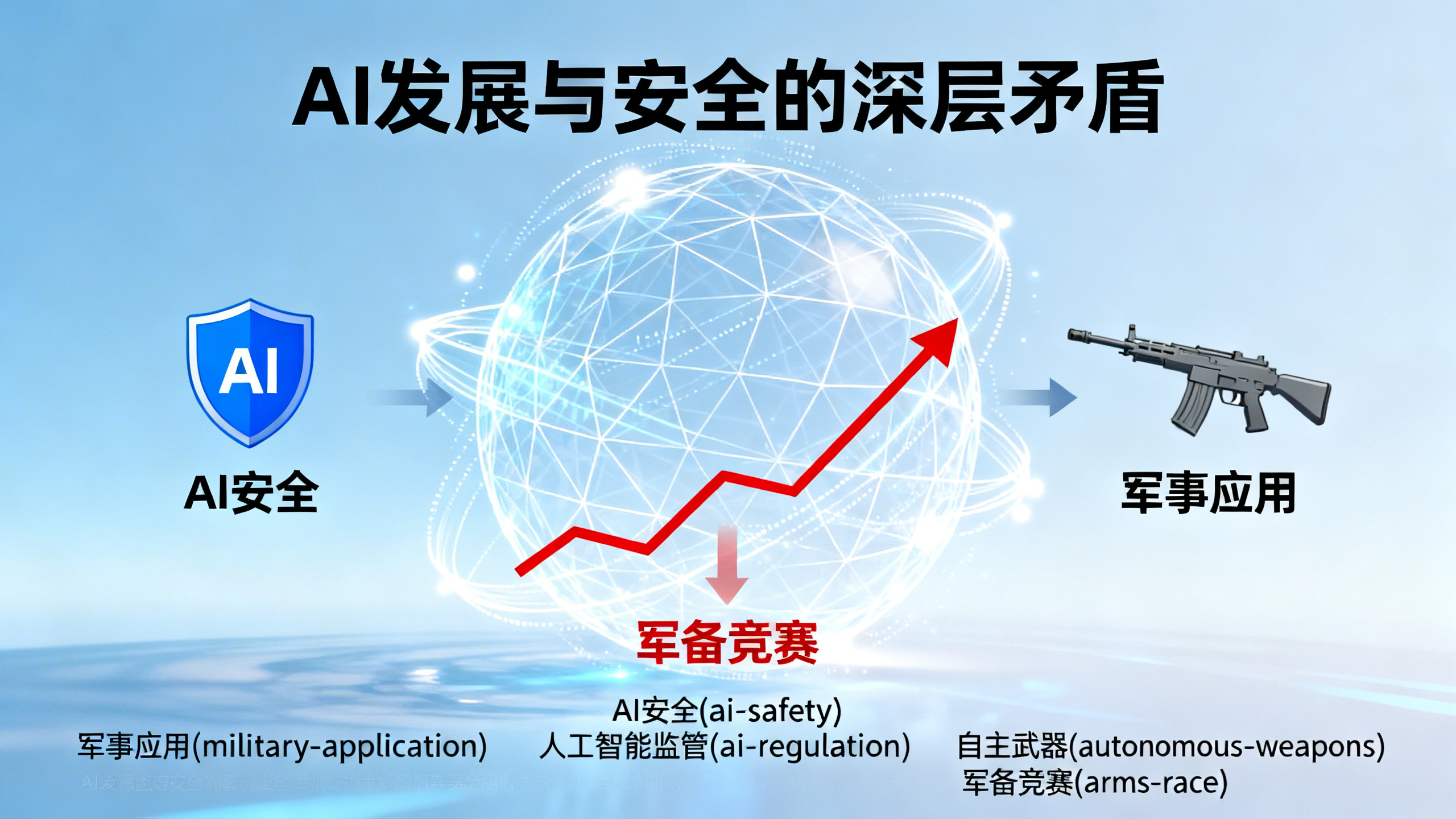

这里有很多问题值得探讨。一方面,有人质疑Anthropic是否因抱怨其AI模型Claude被用于推翻委内瑞拉总统尼古拉斯·马杜罗的突袭行动(相关报道如此,该公司予以否认)而受到“惩罚”。此外,Anthropic公开支持人工智能监管——这在行业内是一种非主流立场,与本届政府的政策相悖。但还有一个更大、更令人不安的问题:政府对军事用途的需求会让AI本身变得更不安全吗?

研究人员和企业高管认为,AI是人类有史以来发明的最强大技术。几乎所有当前的AI公司都是基于这样一个前提成立的,即有可能以一种防止广泛伤害的方式实现通用人工智能(AGI)或超级智能。xAI创始人埃隆·马斯克曾是限制AI发展的最大支持者——他联合创立OpenAI,就是因为担心这项技术太危险,不能落入逐利公司手中。

Anthropic在所有AI公司中以最注重安全而著称。该公司的使命是将安全防护机制深度融入其模型,使不良分子无法利用AI最危险的潜力。艾萨克·阿西莫夫在他的机器人三定律中首次且最好地阐述了这一点:机器人不得伤害人类,或因不作为而让人类受到伤害。即使AI变得比地球上任何人类都聪明——这是AI领袖们坚信的必然结果——这些防护机制也必须有效。

因此,领先的AI实验室争先恐后地将其产品应用于尖端军事和情报行动,这似乎很矛盾。作为首家拥有机密合同的主要实验室,Anthropic为政府提供“一套专为美国国家安全客户打造的Claude Gov定制模型”。不过,Anthropic表示,此举并未违反其自身安全标准,包括禁止使用Claude生产或设计武器。Anthropic首席执行官达里奥·阿莫迪明确表示,他不希望Claude参与自主武器或AI政府监控。但这可能与本届政府的想法不符。美国国防部首席技术官埃米尔·迈克尔(曾任优步首席商务官)本周告诉记者,政府不会容忍AI公司限制军方在武器中使用AI的方式。“如果有无人机群从军事基地飞来,你有什么办法将其击落?如果人类反应速度不够快……你该怎么办?”他反问道。阿西莫夫的机器人第一定律在这面前似乎荡然无存。

有一种合理的观点认为,有效的国家安全需要来自最具创新力公司的最佳技术。尽管几年前,一些科技公司对接 Pentagon 还会犹豫,但到2026年,它们通常都成了摇旗呐喊、渴望成为军事承包商的角色。我还没听过任何AI高管谈论其模型与致命武力有关联,但Palantir首席执行官亚历克斯·卡普却毫不避讳,甚至带着明显的自豪说:“我们的产品有时被用来杀人。”

美国在与委内瑞拉这样的国家作战时,或许可以不受惩罚地展示其AI实力。但复杂的对手将不得不积极开发自己的国家安全AI版本,结果将引发全面的军备竞赛。当涉及致命行为时,政府可能对那些坚持例外条款或对“合法使用”进行法律上咬文嚼字区分的AI公司没什么耐心(尤其是一个随意重新定义法律以证明许多人认为是战争罪的行为正当的政府)。Pentagon的声明明确表示:如果AI公司想与国防部合作,就必须承诺不惜一切代价取胜。

这种心态在Pentagon或许说得通,但却把创建安全AI的努力推向了错误的方向。如果你正在创建一种不会伤害人类的AI,同时又研发具有致命武力的版本,这会适得其反。就在几年前,各国政府和科技高管还在认真讨论可能有助于监控和限制AI有害用途的国际机构。现在这种讨论已经很少听到了。如今,战争的未来是AI,这已成为既定事实。更可怕的是,如果制造AI的公司和使用AI的国家不注意控制这项技术,AI本身的未来可能会更容易出现战争中的那种暴力。

我长期以来认为,我们这个时代的主要故事是数字技术的崛起。政客、政权甚至国家可能会更迭,但技术对人类的重塑是不可逆转的。2016年唐纳德·特朗普首次当选总统时,我在一篇题为《iPhone比唐纳德·特朗普更重要》的专栏中阐述了这一理论。2024年他再次当选时,我写了一篇续篇,认为AI是比总统更大的混乱制造者。我认为,从长远来看,科学甚至比特朗普更有影响力。

现在这个理论感觉有点站不住脚了。未来可能取决于谁掌控先进AI,以及他们如何塑造和利用它。虽然AI巨头们打着爱国旗号寻求与Pentagon合作,但事实是,他们正在向一个拒绝监督的政府和军方提供一种极其强大且不可预测的技术。阿西莫夫会怎么想呢?